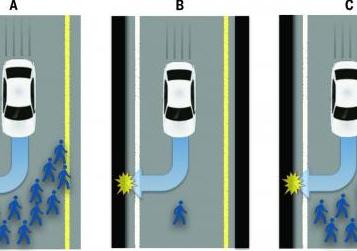

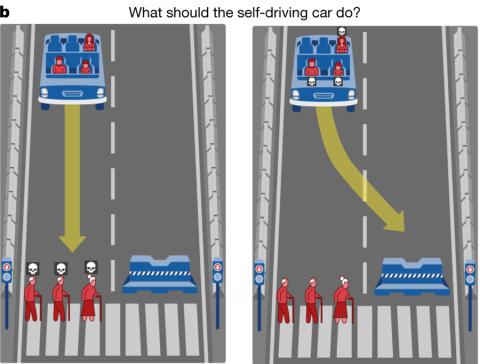

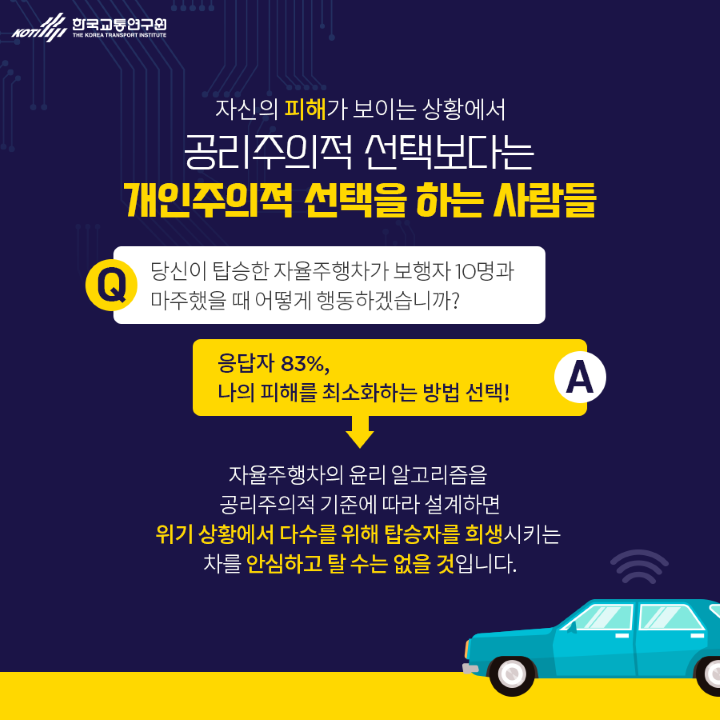

1. 문제 AI기술이 점차 발전하고 보다 고차원적인 의사 결정에도 점차 AI을 적용하고 있습니다.그러면서 AI에 의한 새로운(?)윤리적 딜레마도 발생하는 것 같습니다.링크한 유튜브 영상에서는 자동 운전 자동차가 사고 상황에 직면했을 때 어떤 기준에서 의사 결정을 해야 하느냐는 딜레마를 소개합니다.드라이버 보호를 우선해야 할지 남의 위험을 최소한에 그쳐야 할지, AI는 미리 봐둔 알고리즘과 우선 순위에 의해서 판단하지만 무엇을 기준으로 해야 하느냐가 문제입니다.이들 문제는 어떻게 답변해야 합니까.제 생각에는 결국 기준을 무엇으로 할 것인가, 누가 정하는지, 누가 책임 지느냐에 따라서 달라지실걸요.그리고 이에 대해서는 “절대적 정답”은 없다고 생각합니다. 왜냐하면 원래”기준 자체”을 평가하는데 기준 자체를 평가하려면 별도의 기준이 필요한 것으로 기준이 무한히 소급된다고 생각하기 때문입니다.어쩌면 누가 그 문제를 결정할지가 가장 중요하지 않을까 생각하고, 그 결정에 대해서는 그에 비례하는 책임을 묻지 않으면 안 되는 것은 아닐까 생각합니다.2. 주체들, 우선 그 문제를 결정하는 데 관여하는 주체는 크게 보면 3정도 있는 것 아닐까 합니다.1)사회, 2)기업 3)소비자 1)사회의 경우 사회란 실제보다 상당히 추상화된 주체가 있습니다. 어쩌면 특정 정부 기관에 대표되는 나라일지도 모릅니다. 다만 국가 자체를 개인의 집합과 보는 관점에서는 사회가 수용되는 기준이 합의되어 그 기준을 정책화하는 것이 하나의 가능성이 아닐까요.단지 사회가 사회 전체를 고려하고 의사 결정을 한다면 나로서는 공리주의적인 의사 결정하는 것이 합리적이지 않느냐는 의견입니다. 정책상의 문제 위 옆에선 사회의 공리를 기준으로 결정하는 것이 적당하지 않을까요?2)기업의 경우 기업이 의사 결정을 하면 어떨까요? 실제로 특별한 기준이 없으면 실제로 생산 과정에서 의사 결정이 실질적인 결과를 정의하게 될 것 같습니다. 그런 의미에서는 가장 실제적인 주첼지도 모르겠네요.만약 이와 같은 기준이 없다면 기업은 기업 이익을 최대화하는 선택을 하는 게 아닌가 싶습니다 소비자로 선정되는 기준 또 만일 법적 문제가 생기면 책임을 회피할 수 있는 기준 같은 것인가요? 제가 기업의 주체(?)이었던 것은 없어서 상상하는 것은 쉽지 않습니다.아마도 정책적 결정의 영향 아래에서 이익을 최대화하는 선택을 하겠습니까?3)소비자의 경우 만일 기업이 소비자에게 선택권을 준다면 어떨까요? 원래 관련 옵션을 두고 선택할 수 있도록 하는 것입니다. 쉽게 생각하면 자신을 지킬지, 공리를 우선하는 듯한 것을 결정하는 것입니다. 이러면 소비자의 입장에서는 자신이 결정되는 것은 장점일지도 모르겠네요. 자신의 가치관에 맞는 선택을 할 수 있습니다. 다만 그런 선택 사항을 주겠다는 것은 책임도 함께 주지 않을까 생각합니다. 옵션을 부여한 것으로 책임을 다하고 나머지는 선택한 사람의 책임이라고 할 수 있지 않을까요?3. 개인적 의견, 제 생각으로는 기본적으로는 공리주의적인 기준이 사회에서는 타당하지 않나 생각합니다. 누군가의 목숨이 더 가치가 있다고 결정하는 것은 어렵지 않을까요?혹시 영상에 예로 나온 헬멧을 쓰거나 쓰지 않았을 경우 같은 것까지 세부적으로 따지는 것은 지나칠지도 모른다는 생각도 합니다.오히려 개인의 가치는 동등하게 헤아리며, 등가의 경우는 랜덤으로 결정하는 게 좋을지도 모르겠습니다.이런 건 어떨까요? 나라의 전문 기관에서 관련 가이드 라인을 정의하고 그 같은 가이드 라인을 충족한 것을 인증하고, 그에 부합시킨 경우에는 기업과 개인의 책임을 묻지 않고 자율적으로 한 경우에는 잘못된(?)판단을 한 주체에는 그에 비례하는 책임을 묻거나?실제로 인간인 이상, 모든 상황을 예측하고 완벽한 대응을 하는 것은 불가능할 겁니다. 호불호에 불구하고 사고는 일어날 겁니다. 그리고 그런 사고가 적절히 억제(?) 되게 하려면 통제 가능한 영역 내에서는 의사 결정자에게 책임을 물어야 하는 것 같아요. 자신에게 피해가 돌아오지 않을 때는 이기적인 선택을 하는 경우도 있고 그런 선택이 결국 돌고 도는 우리들에게 오기도 하니까요.그렇군요. 과연 앞으로 이런 문제에 대해서 어떤 답이 내리는 것인가요?